GitHub 更新了 Copilot 的 AI 模型,Copilot 是一种在 Visual Studio 中生成实时源代码和功能推荐的编程助手,并表示它现在更安全、更强大。

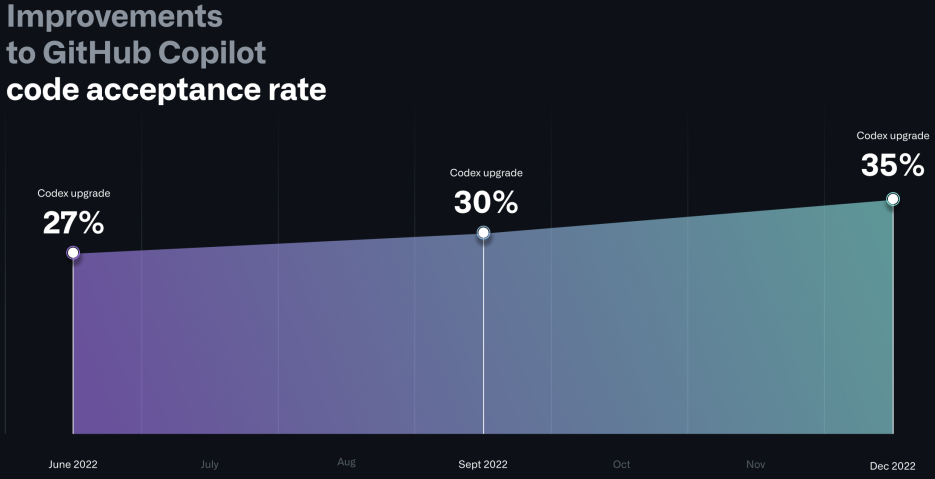

该公司表示,将于本周向用户推出的新 AI 模型可以在更短的时间内提供更优质的建议,通过提高接受率进一步提高软件开发人员使用它的效率。

Copilot 将引入一种称为“中间填充”的新范式,它使用已知代码后缀的库并为 AI 工具留下空白来填充,从而与项目的其余部分实现更好的相关性和连贯性 代码。

此外,GitHub 还更新了 Copilot 的客户端,将不需要的建议减少了 4.5%,从而提高了整体代码接受率。

“当我们于 2022 年 6 月首次推出面向个人的 GitHub Copilot 时,平均有超过 27% 的开发人员代码文件是由 GitHub Copilot 生成的,”产品管理高级总监赵书银说。

“如今,GitHub Copilot 支持所有编程语言中平均 46% 的开发人员代码——而在 Java 中,这个数字跃升至 61%。”

更安全的建议

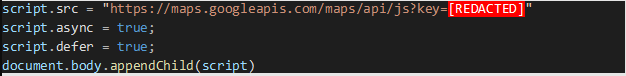

此 Copilot 更新中的一项重要改进是引入了新的安全漏洞过滤系统,该系统将有助于识别和阻止不安全的建议,例如硬编码凭据、路径注入和 SQL 注入。

“新系统利用 LLM(大型语言模型)来模拟静态分析工具的行为——由于 GitHub Copilot 在强大的计算资源上运行高级 AI 模型,它的速度非常快,甚至可以检测不完整代码片段中的漏洞模式 ”赵说。

“这意味着不安全的编码模式会很快被阻止并被替代建议所取代。”

这家软件公司表示,Copilot 可能会生成密钥、凭据和密码等秘密信息,这些信息可以在新字符串的训练数据中看到。 但是,这些内容完全是虚构的,因此无法使用,并且会被新的过滤系统阻止。

Copilot 代码建议中出现的这些秘密引起了软件开发社区的强烈批评,许多人指责微软使用大量公开可用的数据集来训练其 AI 模型,几乎不考虑安全性,甚至包括错误的数据集 包含秘密。

通过实时阻止编辑器中的不安全建议,GitHub 还可以提供一些抵抗中毒数据集攻击的能力,这些攻击旨在暗中训练 AI 助手提出包含恶意负载的建议。

此时,Copilot 的 LLM 仍在接受训练以区分易受攻击和不易受攻击的代码模式,因此 AI 模型在这方面的性能有望在不久的将来逐渐提高。

如若转载,请注明出处:https://www.ozabc.com/it/534771.html